Technologie et économie

07-03-2026 | 12:41

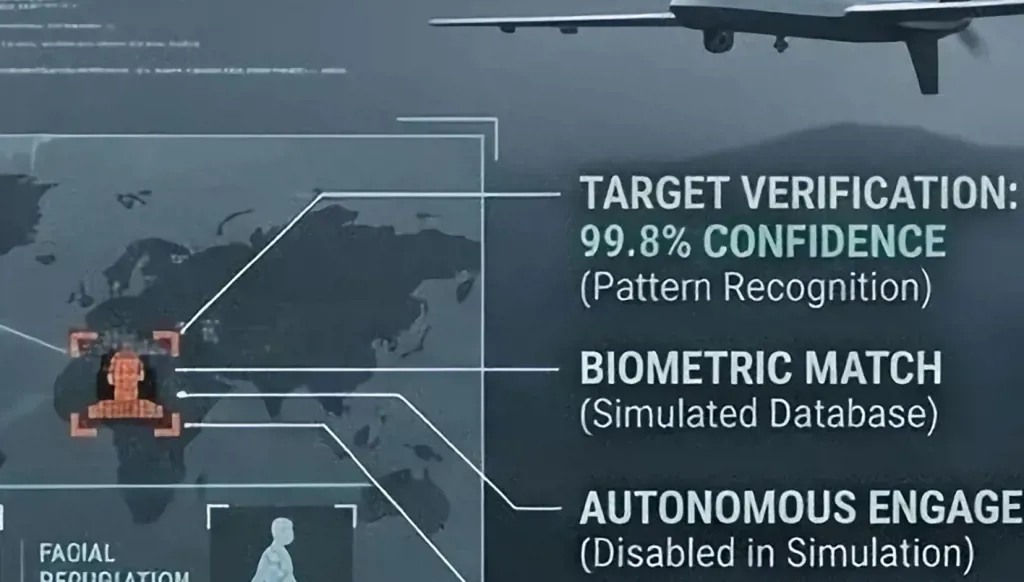

Quand les algorithmes décident qui meurt : Le rôle de l'IA dans les conflits au Moyen-Orient

Par Shafiq Taher Les preuves croissantes montrent que l'IA façonne les opérations létales de Gaza à l'Iran, soulevant des alarmes éthiques et politiques mondiales.

Quand les algorithmes décident qui meurt : Les preuves croissantes montrent que l'IA façonne les opérations létales de Gaza à l'Iran

العلامات الدالة

الأكثر قراءة

ثقافة

4/23/2026 12:24:00 PM

فيلم "سوبر ماريو" يتصدّر عالمياً رغم تقييمات نقدية ضعيفة.

لبنان

4/29/2026 10:51:00 AM

اكتشاف مغارةٍ جديدة والكشف عن طبيعتها ومعالمها في خراج بلدة تاشع أعالي محافظة عكار

لبنان

4/30/2026 1:28:00 PM

تشهد المدرسة احتفالات دينية وعمليات تكليف شرعي وإقامة طقوس دينية، ومناسبات اجتماعية، وسط حماية أمنية من "حزب الله"

لبنان

4/30/2026 2:25:00 PM

بدأت الإجراءات القضائية المذكورة على أثر ادعاءات وجّهها المدّعون إلى مصرف لبنان، مفادها أنه أسهم في استقطاب ودائعهم بالدولار الأميركي من خلال تطمينات مضلّلة حول سلامة الأموال وإمكانية الوصول إليها

مسنجر

مسنجر

واتساب

واتساب

ثريدز

ثريدز

بريد إلكتروني

بريد إلكتروني

الطباعة

الطباعة

تويتر

تويتر

فيسبوك

فيسبوك